NVIDIA (NVDA +1,73%) ha sido uno de los mayores beneficiarios del auge de los chips de inteligencia artificial (IA). Sus unidades de procesamiento de gráficos (GPU) son procesadores paralelos, diseñados para dividir ciertos tipos de cálculos enormemente complejos en una serie de partes más pequeñas y luego realizar todos esos pequeños cálculos simultáneamente, en lugar de realizar cada tarea en secuencia. Y resulta que el proceso de entrenamiento de modelos de lenguaje grandes (LLM) depende en gran medida del tipo de tareas en las que sobresalen las GPU.

Como resultado, en los últimos años, la demanda de las GPU líderes en la industria de Nvidia se ha disparado, impulsando un crecimiento sorprendente en los ingresos y ganancias de la compañía.

Los principales hiperescaladores y empresas de inteligencia artificial, como Amazonas (AMZN +0,55%), microsoft, Metaplataformasy Alfabeto‘s (¡¡¡¡¡¡¡¡¡¡¡¡¡¡¡¡¡¡¡¡¡¡¡¡¡ +0,41%) (GOOGL +0,66%) Google lleva mucho tiempo confiando en el hardware de Nvidia para entrenar potentes modelos de IA.

Lo que vale la pena señalar es que los rivales de Nvidia no han podido hacer mella en su dominio de los chips de IA. Controla aproximadamente el 81% del mercado de chips para centros de datos de IA, según IDC. La buena noticia para los inversores en acciones de Nvidia es que el crecimiento candente de la compañía podría continuar: la compañía pronostica ventas totales de 1 billón de dólares para sus arquitecturas Blackwell y Vera Rubin en 2026 y 2027.

Sin embargo, existe amplia evidencia de que la posición de Nvidia en los chips de IA se está debilitando gradualmente.

Fuente de la imagen: Nvidia.

Los clientes de Nvidia se están convirtiendo en competidores

La formación de LLM requiere mucha potencia informática, razón por la cual Amazon, Meta, Microsoft, Alphabet y otros han estado comprando millones de GPU Nvidia. Sin embargo, estos clientes también han estado diseñando sus propios chips para ejecutar cargas de trabajo de IA de forma rentable en sus centros de datos. Los altos costos y las limitaciones de suministro asociadas con las populares tarjetas gráficas de Nvidia explican por qué estos clientes han estado trabajando internamente en sus propios chips durante mucho tiempo.

El cambio de hoy

(1,73%) $3.66

Precio actual

$215.16

Puntos de datos clave

Capitalización de mercado

5,2 billones de dólares

Rango del día

$212.90 -$217,79

Rango de 52 semanas

$120.28 -$217.80

Volumen

5,2 millones

Volumen promedio

171M

Margen bruto

71.07%

Rendimiento de dividendos

0,02%

Google, por ejemplo, lanzó la primera generación de su Unidad de Procesamiento Tensor (TPU) en 2015, mientras que el chip personalizado Trainium interno de Amazon se lanzó en diciembre de 2020. Ambas empresas han mejorado sus chips a lo largo de los años. De hecho, ahora están vendiendo estos chips a terceros.

Amazon, por ejemplo, reveló recientemente que su negocio de chips registró un crecimiento secuencial del 40% en el primer trimestre de 2026. La tasa de ingresos anuales del negocio de semiconductores de Amazon supera ahora los 20 mil millones de dólares. Es más, la compañía «Magnificent Seven» señala que la tasa de ejecución de ingresos del segmento está mejorando en porcentajes de tres dígitos año tras año.

Otro punto clave es que la tasa de ejecución anual del segmento estaría más cerca de los 50 mil millones de dólares si incluyera sus «ventas» de chips a sí mismo para su uso en los centros de datos de AWS. Es más, la demanda de los chips Trainium de Amazon es tan fuerte que el acceso a ellos está completo. Sus procesadores de IA personalizados están siendo implementados por Anthropic, OpenAI, Uber e incluso Meta Platforms, que utiliza la unidad central de procesamiento (CPU) Graviton interna de Amazon para admitir aplicaciones de IA agentes.

Resulta que Amazon tiene la friolera de 225 mil millones de dólares en compromisos de compra para sus chips Trainium AI, lo que sugiere claramente que su negocio de semiconductores está preparado para un crecimiento espectacular.

Mientras tanto, Google también ha estado causando sensación en el mercado de chips de IA. El gigante tecnológico tiene acuerdos importantes con Meta Platforms y Anthropic para el despliegue de sus TPU. El director ejecutivo, Sundar Pichai, considera que el negocio de TPU es uno de sus principales motores de crecimiento y la empresa ahora está vendiendo sus chips a más clientes.

En la última conferencia telefónica sobre resultados de Alphabet, Pichai comentó:

A medida que crezca la demanda de TPU por parte de los laboratorios de inteligencia artificial, las empresas de los mercados de capital y las aplicaciones informáticas de alto rendimiento, comenzaremos a entregar TPU a un grupo selecto de clientes en sus propios centros de datos en la configuración de hardware para ampliar nuestra oportunidad de mercado direccionable.

Esta oportunidad aprovechable podría ser enorme a largo plazo. Aunque Google aún no ha revelado públicamente el tamaño de su negocio de TPU, la firma de inversión DA Davidson estima que podría valer la friolera de 900 mil millones de dólares a largo plazo, suponiendo que la compañía decida vender seriamente sus chips a terceros.

Ahora parece que Google se está tomando en serio su negocio de TPU, y eso probablemente creará más problemas para el imperio de chips de inteligencia artificial de Nvidia.

¿Podrá Nvidia contraatacar?

Nvidia no se quedará sentada y observará mientras sus clientes se convierten en competidores. La razón por la que los procesadores personalizados de Amazon y Google han estado ganando tremendo impulso es que son circuitos integrados para aplicaciones específicas: chips que están optimizados para manejar una gama relativamente estrecha de cargas de trabajo, en contraste con las GPU más flexibles de Nvidia, que son adecuadas para una amplia gama de tareas. De este modo, los chips personalizados pueden realizar tareas de inferencia de IA de manera más eficiente, reduciendo el costo operativo total de los centros de datos.

Nvidia está contrarrestando la amenaza de empresas como Amazon y Google realizando mejoras en su propio hardware que reducen significativamente el costo de la inferencia de IA con sus GPU. Además, Nvidia ha decidido ofrecer su CPU de servidor Vera como un producto independiente por primera vez, en lugar de ofrecerlo únicamente como parte de la plataforma Vera Rubin. La compañía ha tomado esta medida porque está viendo un gran interés en sus CPU de servidor Vera. De hecho, la compañía cree que su negocio de CPU para servidores podría convertirse en una apuesta multimillonaria.

Los esfuerzos de Nvidia por ir más allá en el desarrollo de productos deberían ayudarla a protegerse de la creciente competencia. Además, los inversores no deben olvidar que el mercado de chips de IA sigue expandiéndose rápidamente. banco de america estima que el mercado mundial de semiconductores podría generar 2 billones de dólares en ingresos en 2030. Gartnerpor otro lado, estima que los chips de IA representarán la mitad del mercado mundial de semiconductores para finales de la década.

Por lo tanto, hay un amplio espacio para que más de un actor importante prospere en este espacio. Nvidia reportó 194 mil millones de dólares en ingresos por centros de datos el año pasado, y el tamaño del mercado al que se dirige sugiere que todavía tiene un espacio significativo para crecer en este segmento. Además, la empresa está tomando medidas para defender su dominio. Como tal, es fácil ver por qué los analistas siguen siendo optimistas sobre las perspectivas de Nvidia; puede seguir registrando un crecimiento saludable en las ventas de centros de datos incluso si pierde parte del mercado de chips de IA.

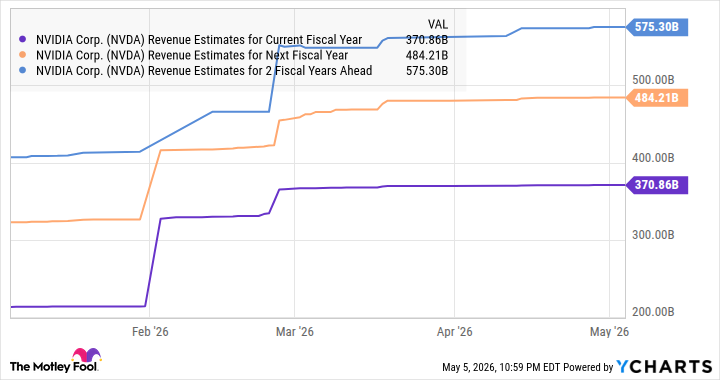

Estimaciones de ingresos de NVDA para los datos del año fiscal actual por YCharts.

Además, su múltiplo de beneficios futuros de 24 está muy por debajo del centrado en la tecnología. NasdaCompuesto múltiplo de ganancias promedio del índice de 40,6. El potencial de crecimiento de las ganancias de la compañía sugiere que está infravalorada en este momento. Por eso tiene sentido conservar este stock de IA, a pesar de la creciente competencia en el mercado de chips para centros de datos.