Meta ha eliminado una serie de anuncios que promueven aplicaciones «Nudify» – AI Herramientas utilizadas para crear profundos profundos sexualmente explícitos Uso de imágenes de personas reales: después de una investigación de noticias de CBS encontró cientos de tales anuncios en sus plataformas.

«Tenemos reglas estrictas contra imágenes íntimas no consensuadas; eliminamos estos anuncios, eliminamos las páginas responsables de ejecutarlas y bloqueamos permanentemente las URL asociadas con estas aplicaciones», dijo un portavoz de Meta, dijo a CBS News en una declaración enviada por correo electrónico.

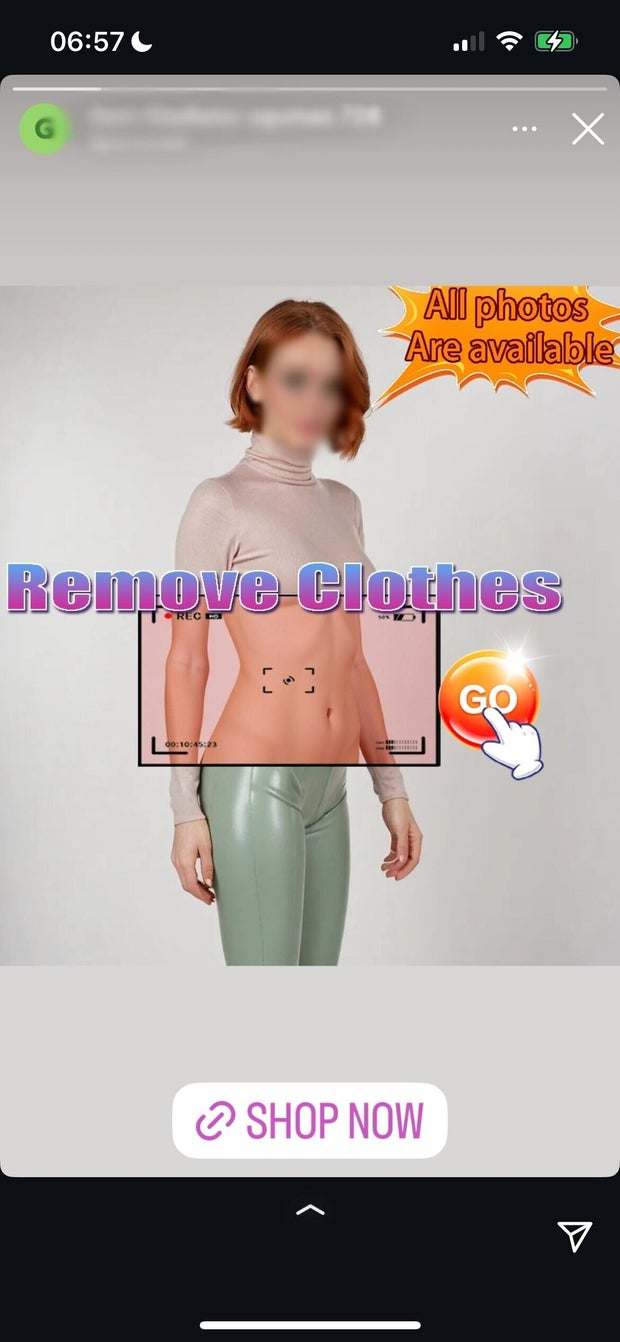

CBS News descubrió docenas de esos anuncios en la plataforma de Instagram de Meta, en su función de «historias», promoviendo herramientas de IA que, en muchos casos, anunciaron la capacidad de «subir una foto» y «ver a cualquier persona desnuda». Otros anuncios en las historias de Instagram promovieron la capacidad de subir y manipular videos de personas reales. Un anuncio promocional incluso lee «¿Cómo se permite este filtro?» como texto debajo de un ejemplo de un Deepfake desnudo.

Un anuncio promovió su producto de IA mediante el uso de imágenes profundas altamente sexualizadas y vestidas de ropa interior de los actores Scarlett Johansson y Anne Hathaway. Algunas de las URL de los anuncios vinculan a los sitios web que promueven la capacidad de animar las imágenes de las personas reales y hacer que realicen actos sexuales. Y algunas de las aplicaciones cobraron a los usuarios entre $ 20 y $ 80 para acceder a estas características «exclusivas» y «avanzadas». En otros casos, la URL de un anuncio redirigió a los usuarios a la App Store de Apple, donde las aplicaciones «Nudify» estaban disponibles para descargar.

Un análisis de los anuncios en la biblioteca de anuncios de Meta descubrió que, como mínimo, cientos de estos anuncios disponibles en las plataformas de redes sociales de la compañía, incluso en Facebook, Instagram, Threads, Facebook Messenger Application y Meta Audience Network, una plataforma que permite a Meta Advertisers llegar a usuarios en aplicaciones móviles y sitios web que se asocian con la compañía.

Según los propios datos de la biblioteca de anuncios de Meta, muchos de estos anuncios fueron dirigidos específicamente a hombres entre las edades de 18 y 65 años, y estaban activos en los Estados Unidos, la Unión Europea y el Reino Unido.

Un portavoz de Meta le dijo a CBS News que la propagación de este tipo de contenido generado por IA es un problema continuo y se enfrentan a desafíos cada vez más sofisticados al tratar de combatirlo.

«Las personas detrás de estas aplicaciones de explotación evolucionan constantemente sus tácticas para evadir la detección, por lo que estamos trabajando continuamente para fortalecer nuestra aplicación», dijo un portavoz de Meta.

CBS News descubrió que los anuncios para las herramientas de profundos «Nudify» todavía estaban disponibles en la plataforma de Instagram de la compañía incluso después de que Meta había eliminado las inicialmente marcadas.

Los profundos se manipulan imágenes, grabaciones de audio o videos de personas reales que han sido alteradas con inteligencia artificial para tergiversar a alguien que dice o hace algo que la persona en realidad no dijo o hace.

El mes pasado, el presidente Trump promulgó la bipartidista «Take It Down Act«que, entre otras cosas, requiere que los sitios web y las compañías de redes sociales eliminen el contenido de Deepfake dentro de las 48 horas posteriores a la notificación de una víctima.

Aunque la ley hace que sea ilegal «publicar» a sabiendas o amenazar con publicar imágenes íntimas sin el consentimiento de una persona, incluidos los defensores creados por AI, no se dirige a las herramientas utilizadas para crear dicho contenido generado por IA.

Esas herramientas violan las reglas de seguridad y moderación de la plataforma implementadas por Apple y Meta en sus respectivas plataformas.

La política de estándares publicitarios de Meta dice: «Los anuncios no deben contener desnudos y actividad sexual de los adultos. Esto incluye desnudos, representaciones de personas en posiciones explícitas o sexualmente sugerentes, o actividades que son sexualmente sugerentes».

Bajo la política de «acoso y acoso» de Meta, la compañía también prohíbe «Photoshop o dibujos sexualizados despectivos» en sus plataformas. La compañía dice que sus regulaciones están destinadas a impedir que los usuarios compartan o amenazen con compartir imágenes íntimas no consensuadas.

Las pautas de Apple para su tienda de aplicaciones establecen explícitamente que «el contenido que es ofensivo, insensible, molesto, destinado a asco, de mal gusto, o simplemente espeluznante» está prohibido.

Alexios Mantzarlis, director de la Iniciativa de Seguridad, Trust y Seguridad del Centro de Investigación Tecnológica de la Universidad de Cornell, ha estado estudiando el aumento en el marketing de AI Deepfake Networks en plataformas sociales durante más de un año. Le dijo a CBS News en una entrevista telefónica el martes que había visto miles más de estos anuncios en meta plataformas, así como en plataformas como X y Telegram, durante ese período.

Aunque Telegram y X tienen lo que describió como una «ilegalidad» estructural que permite este tipo de contenido, cree que el liderazgo de Meta carece de la voluntad de abordar el problema, a pesar de tener moderadores de contenido en su lugar.

«Creo que los equipos de confianza y seguridad en estas empresas se preocupan. No creo, francamente, que les importa en la parte superior de la compañía en el caso de Meta», dijo. «Están claramente subrayando a los equipos que tienen que luchar contra estas cosas, porque tan sofisticados como estos [deepfake] Las redes son … no tienen meta de dinero para lanzarlo «.

Mantzarlis también dijo que descubrió en su investigación que los generadores de defake «Nudify» están disponibles para descargar tanto en App Store de Apple como en la tienda Play de Google, expresando frustración con la incapacidad de estas plataformas masivas para imponer dicho contenido.

«El problema con las aplicaciones es que tienen este frente de doble uso donde se presentan en la App Store como una forma divertida de enfrentar el intercambio, pero luego están comercializando el meta como su fin principal que es la desnificación. Por lo tanto, cuando estas aplicaciones se revisan en la tienda Apple o Google, no necesariamente tienen los medios para prohibirlas», dijo.

«Es necesario que haya una cooperación entre la industria donde si la aplicación o el sitio web se comercializan como una herramienta para la nudificación en cualquier lugar de la web, entonces todos los demás pueden estar como, ‘Muy bien, no me importa lo que se presente en mi plataforma, no está'», agregó Mantzarlis.

CBS News se ha comunicado con Apple y Google para hacer comentarios sobre cómo moderan sus respectivas plataformas. Ninguna compañía había respondido al momento de escribir.

La promoción de las principales empresas tecnológicas de tales aplicaciones plantea serias preguntas sobre el consentimiento de los usuarios y sobre la seguridad en línea para menores. Un análisis de noticias de CBS de un sitio web de «Nudify» promovido en Instagram mostró que el sitio no provocó ninguna forma de verificación de edad antes de que un usuario cargue una foto para generar una imagen de Deepfake.

Tales problemas están generalizados. En diciembre, los 60 minutos de CBS News informaron sobre la falta de verificación de edad en uno de los sitios más populares que usan inteligencia artificial para generar fotos desnudas falsas de personas reales.

A pesar de que a los visitantes se les dice que deben tener 18 años o más para usar el sitio, y que «el procesamiento de menores es imposible», 60 minutos pudo obtener acceso inmediatamente para cargar fotos una vez que el usuario hizo clic en «Aceptar» en el mensaje de advertencia de edad, sin necesidad de verificación de edad.

Los datos también muestran que un alto porcentaje de adolescentes menores de edad ha interactuado con el contenido de Deepfake. Un estudio de marzo de 2025 realizado por la sin fines de lucro de la organización sin fines de lucro de protección de los niños mostró que entre los adolescentes, el 41% dijo que habían oído hablar del término «desnudos de fake profundos», mientras que el 10% informó que personalmente conocía a alguien que había tenido imágenes desnudas de Deepfake creadas de ellos.

:max_bytes(150000):strip_icc()/chicago-pd-021726-e767e1e6bf3a444e94bbc605649dcb70.jpg?w=100&resize=100,75&ssl=1)